알리바바가 실시간 음성 대화가 가능한 AI 모델 Qwen3-Omni, GPT-5와 동급 성능 이미지 인식 모델인 Qwen3-VL 등을 공개하며 대규모로 AI 모델을 발표했다.

알리바바 AI 연구팀 Qwen은 9월 22일 자연어로 실시간 응답이 가능한 AI 모델 Qwen3-Omni를 발표했다. 이어 9월 22일부터 24일까지 짧은 기간 동안 Qwen3-VL Qwen3-TTS, Qwen-Image-Edit-2509, Qwen3-LiveTranslate-Flash, Qwen3-Max 등 다양한 모델을 연이어 공개했다.

Qwen3-Omni는 텍스트·이미지·음성·영상 데이터를 처리해 실시간으로 응답할 수 있는 모델이다. 텍스트와 음성 응답을 지원하며 119개 언어 텍스트 이해, 19개 언어에 대한 음성 이해, 10개 언어 음성 생성 기능을 갖춘 게 특징.

사용자는 스마트폰 카메라에 비친 사물에 대해 Qwen3-Omni와 대화할 수 있다. Qwen이 공개한 벤치마크에서는 Qwen3-Omni-Flash가 GPT-4o나 Gemini-2.5-Flash와 동등하거나 그 이상 성능을 보였고 Qwen3-Omni-30B-A3B는 대부분의 테스트에서 GPT-4o를 상회했다. 모델은 허깅페이스에서 공개됐다.

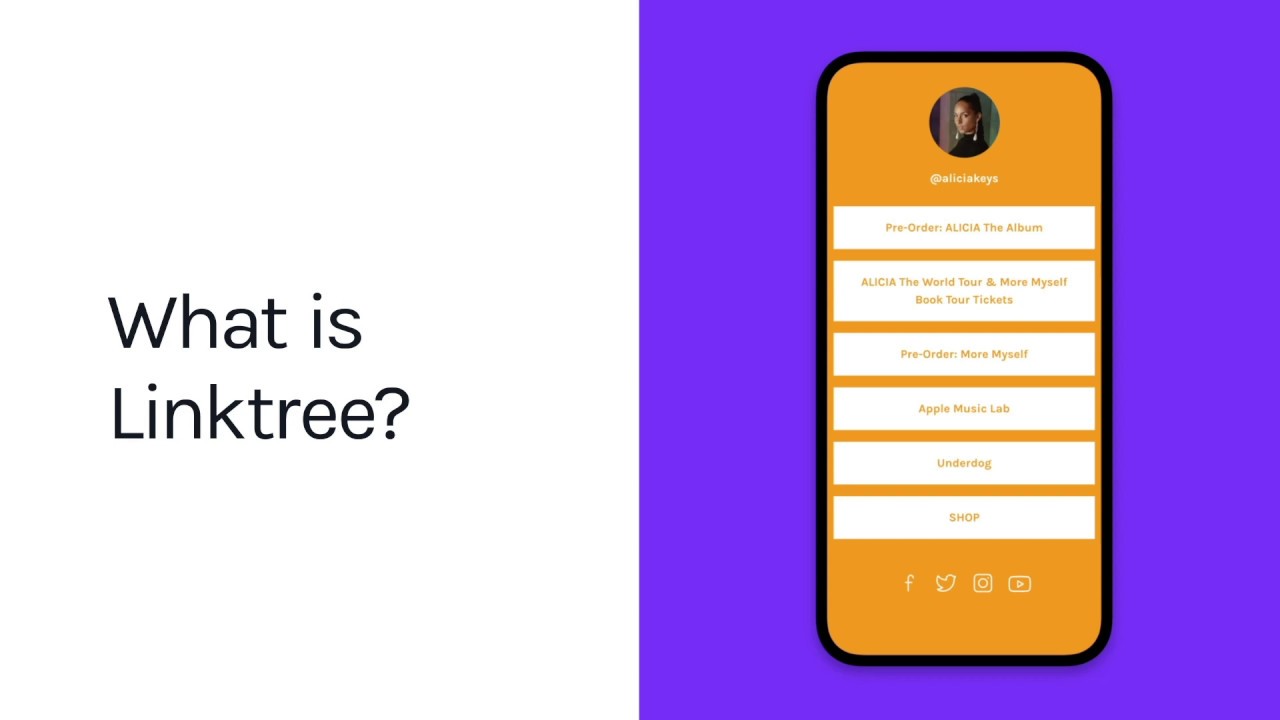

Qwen3-VL은 고도화된 이미지 인식 기능을 갖춘 비주얼 언어 모델이다. 사진이나 앱 스크린샷 같은 콘텐츠를 이해할 수 있으며 32개 언어에 대한 OCR도 지원한다.

벤치마크 결과, Qwen3-VL-235B-A22B-Instruct는 오픈 모델임에도 불구하고 다수 테스트에서 Gemini-2.5-Pro와 GPT-5를 능가했다. 또 다른 모델인 Qwen3-VL-235B-A22B-Thinking 역시 두 모델을 초과하는 성능을 보였다.

다음으로 Qwen3-TTS는 10개 언어를 지원하는 음성 합성 모델이다. 입력된 음성을 감정을 유지한 채 다른 언어로 번역할 수 있다.

다음으로 Qwen-Image-Edit-2509는 기존 이미지 편집 모델의 업그레이드 버전으로 얼굴이나 제품 일관성을 유지하는 능력이 향상됐다. 다중 이미지 편집을 지원하며 개선된 편집 사례가 공개됐다.

Qwen3-LiveTranslate는 18개 언어를 지원하는 실시간 음성 통역 모델이다. 단순한 음성 입력뿐 아니라 입술 움직임과 제스처 같은 시각적 요소도 입력받아 인식 정확도를 높일 수 있다. 벤치마크에서는 Gemini-2.5-Flash나 GPT-4o-Audio-Preview보다 높은 점수를 기록했다.

Qwen3-Max는 Qwen3 시리즈의 최상위 추론 모델이다. 익명 평가 환경인 Text Arena에서 GPT-5-Chat을 제치고 3위에 올랐다. 현재 Qwen Chat에서 이용할 수 있으며 곧 일반에도 공개될 예정이다. 관련 내용은 이곳에서 확인할 수 있다.

![[AI서머리] 앨리비, ‘AI 계약 리뷰’ 상용화‧미리캔버스, 해외 가입자 100만 명 돌파](https://startuprecipe.co.kr/wp-content/uploads/2025/09/250925_salesforce.com_5002503-75x75.jpg)