메타는 2025년 11월 이미지 및 동영상 내 오브젝트를 감지·분할·식별하는 AI 모델인 SAM 3(Meta Segment Anything Model 3)을 발표했다. 이어 3월 27일 메타는 SAM 3 복수 오브젝트 추적 능력을 향상시킨 버전인 SAM 3.1을 출시했다.

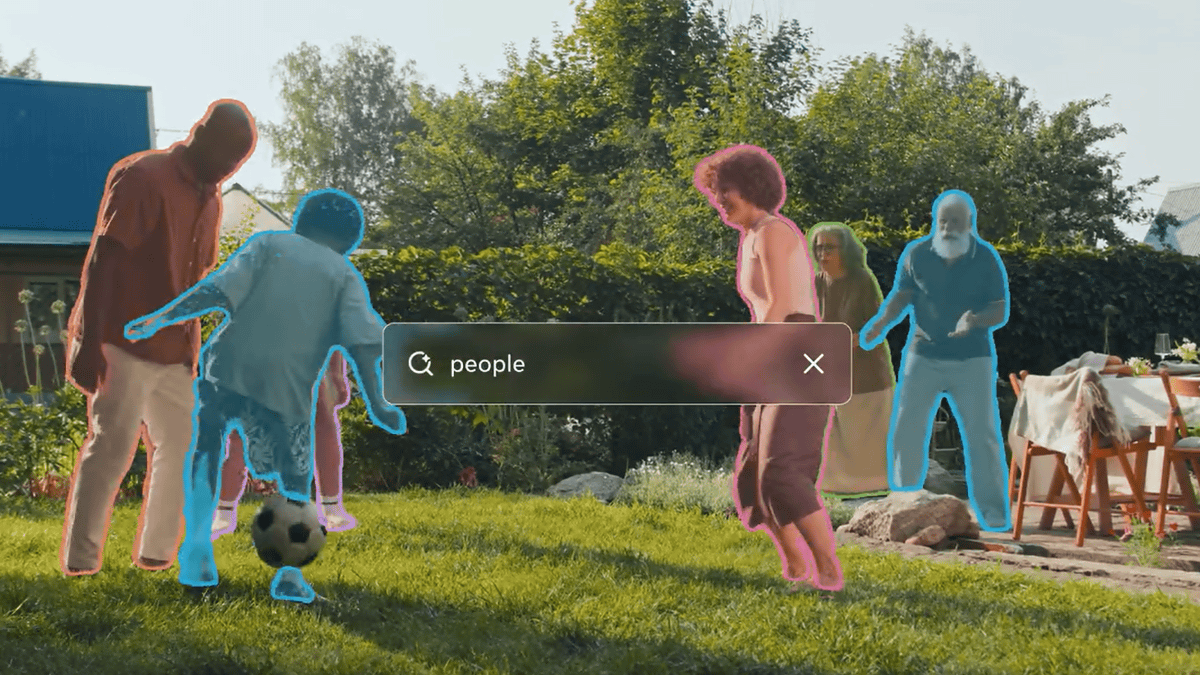

SAM 3는 프롬프트에 기반해 이미지 및 동영상 내 오브젝트를 감지·세그멘테이션·추적할 수 있는 통합 모델이다. 예를 들어 개나 노란 스쿨버스처럼 짧은 텍스트를 입력하거나 범위 지정 또는 클릭으로 동영상 내 오브젝트를 지정하는 방식으로 이미지 및 동영상에서 원하는 오브젝트를 추출할 수 있다.

3월 27일 메타는 SAM 3 성능을 향상시킨 버전인 SAM 3.1을 출시했다. SAM 3.1은 오브젝트 멀티플렉싱(object multiplexing)을 도입해 정확도를 희생하지 않으면서도 동영상 처리 효율을 대폭 향상시켰다고 밝혔다.

오브젝트 멀티플렉싱을 통해 SAM 3.1은 단일 포워드 패스(forward pass)로 최대 16개 오브젝트를 추적할 수 있게 됐다. 기존에는 추적하고자 하는 오브젝트마다 전용 패스가 필요했지만 SAM 3.1은 추적 대상 오브젝트를 동시에 처리해 불필요한 연산과 병목 현상을 제거했다.

메타는 이 접근 방식을 통해 중간 수준 오브젝트 수를 포함하는 동영상 처리 속도가 2배 빨라지며 단일 H100 GPU에서의 처리량이 초당 16프레임에서 32프레임으로 향상된다고 설명했다.

SAM 3와 SAM 3.1 성능을 비교하면 오브젝트 수가 늘어날수록 성능 차이가 커지며 오브젝트가 128개에 달하면 무려 7~8배에 이르는 성능 차이가 나타난다. SAM 3.1 모델을 포함한 체크포인트는 허깅 페이스에서 다운로드할 수 있다. 관련 내용은 이곳에서 확인할 수 있다.

![[AI서머리] 미다스, 690억 시리즈A 투자 유치‧케어닥, IPO 본격 추진](https://startuprecipe.co.kr/wp-content/uploads/2026/04/260402_deepx.ai_50025035-75x75.jpg)

![[AI서머리] 게임인재원, AI 실무교육 외래 강사 모집‧에이아이트릭스, 국제 의료기기 MDSAP 인증 획득](https://startuprecipe.co.kr/wp-content/uploads/2026/04/260402_webcash.co_.kr_50025-350x250.jpg)