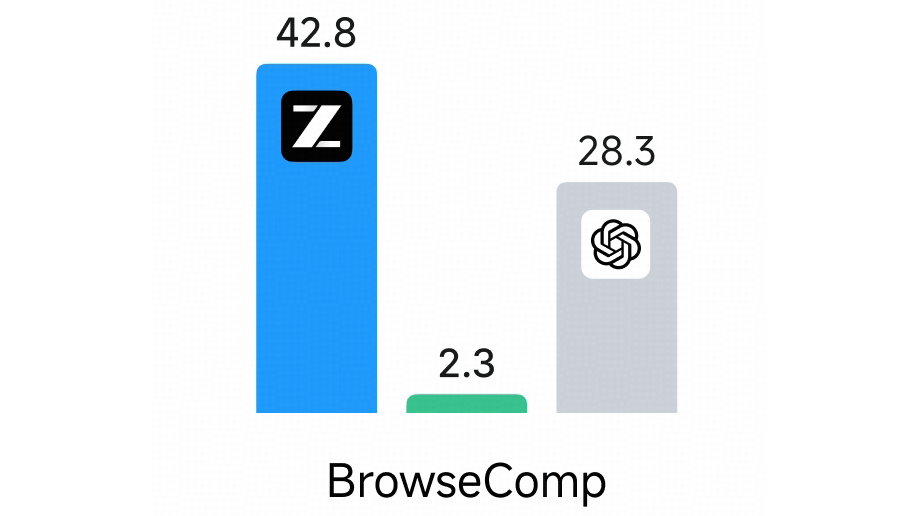

중국에 본사를 둔 AI 기업 Z.ai가 로컬에서 동작하는 경량 AI 모델인 GLM-4.7-Flash를 1월 19일 공개했다. GLM-4.7-Flash는 다수 벤치마크 테스트에서 오픈AI gpt-oss-20b를 상회하는 성능을 보이고 있다.

GLM-4.7-Flash는 복수 전문 모델을 결합하는 MoE 아키텍처를 채택한 AI 모델로 파라미터 수는 300억, 활성 파라미터 수는 30억이다.

GLM-4.7-Flash(총 파라미터 수: 300억, 활성 파라미터 수 30억), Qwen3-30B-A3B-Thinking-2507(총 파라미터 수: 300억, 활성 파라미터 수 30억), gpt-oss-20b(총 파라미터 수: 210억, 활성 파라미터 수 36억) 벤치마크 결과를 보면 대부분 테스트에서 GLM-4.7-Flash가 가장 높은 점수를 기록했다.

Introducing GLM-4.7-Flash: Your local coding and agentic assistant.

Setting a new standard for the 30B class, GLM-4.7-Flash balances high performance with efficiency, making it the perfect lightweight deployment option. Beyond coding, it is also recommended for creative writing,… pic.twitter.com/gd7hWQathC

— Z.ai (@Zai_org) January 19, 2026

GLM-4.7-Flash는 오픈 모델로 개발되고 있으며 MIT 라이선스로 모델 데이터를 다운로드할 수 있다.

Z.ai가 공개한 BF16 버전 GLM-4.7-Flash를 구동하려면 45GB 이상 VRAM이 필요하다. Z.ai는 지포스 RTX 4090으로도 실행할 수 있냐는 질문에 대해 양자화 버전 출시를 기다리도록 안내하고 있다. 관련 내용은 이곳에서 확인할 수 있다.

![[AI서머리] 오렌지플래닛, IPO 연구모임 가동‧혁신벤처업계, ‘벤처 4대 강국 도약’ 신년인사회](https://startuprecipe.co.kr/wp-content/uploads/2026/01/260122_kova_0302235-75x75.jpg)

![[DailyRecipe] 목표는 100개…경기도표 기후테크 34곳 1페이지 브리핑](https://startuprecipe.co.kr/wp-content/uploads/2026/04/260421_Climate-Technology_ai_0503205235-350x250.png)