엔비디아가 미국 샌디에이고에서 개최된 AI 학회(NeurIPS)에서 자동운전과 로봇공학을 위한 오픈 AI 모델 NVIDIA DRIVE Alpamayo-R1과 툴군을 12월 1일 발표했다. 이번 발표 핵심은 디지털 공간 뿐 아니라 현실의 물리적 세계를 인식하고 상호작용하는 피지컬 AI 기반 기술을 강화하는 것에 있다.

이번에 자동운전 연구용으로 공개된 NVIDIA DRIVE Alpamayo-R1은 물리 AI와 로보틱스를 위한 추론 비전 언어 모델인 NVIDIA Cosmos-Reason1을 기반으로 한 새로운 AI 모델로 세계 첫 추론 비전 언어 액션 모델(VLA)이다.

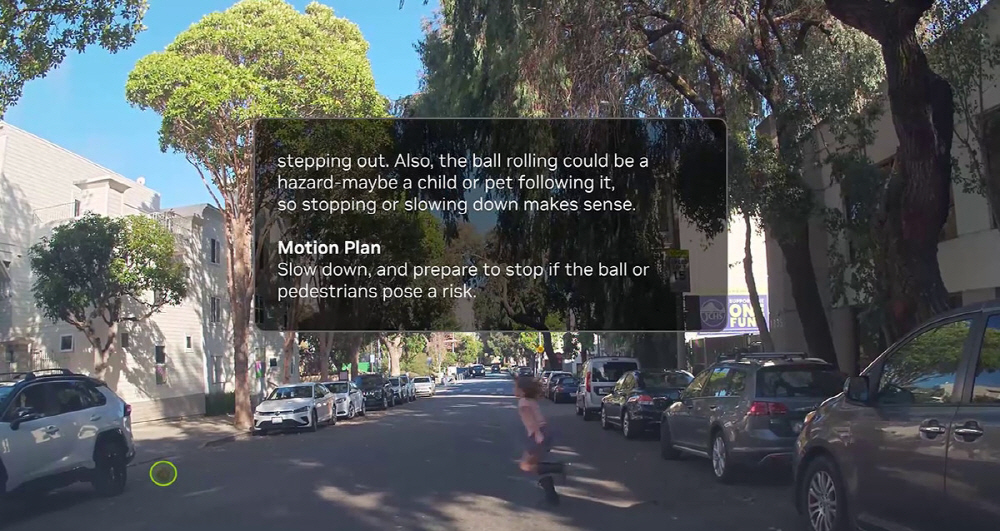

기존 자동운전 AI는 차선 변경이나 장애물 회피 같은 개별 태스크에는 대응할 수 있어도 복잡한 상황 판단에는 취약했다. 하지만 NVIDIA DRIVE Alpamayo-R1은 카메라 영상과 언어 정보를 조합해 처리하고 인간처럼 사고(추론)한 뒤 행동을 결정할 수 있다는 점이 특징이다.

예를 들어 공이 굴러오면 단순히 장애물로 피하는 게 아니라 아이가 쫓아올 수 있으니 서행하자 같은 맥락을 이해한 판단이 가능해진다. 이를 통해 특정 장소나 조건에서 모든 조작을 시스템이 수행하는 레벨 4 자동운전 실현이 가까워질 것으로 기대된다.

현재 NVIDIA DRIVE Alpamayo-R1 데이터셋은 허깅페이스에 공개되어 있다. 또 개발자가 이런 고도의 AI 모델을 자신의 프로젝트에서 활용하기 쉽도록 Cosmos Cookbook이라 불리는 가이드와 툴셋도 제공한다. 여기에는 자동운전 시뮬레이션에 필요한 라이다 데이터를 생성하는 LidarGen, 영상에서 로봇 동작 정책을 만들어내는 Cosmos Policy, 디지털 공간 내 인간이나 로봇을 물리적으로 올바르게 움직이기 위한 ProtoMotions3가 포함되어 있으며 로봇과 자동운전차 개발을 폭넓게 지원한다.

디지털 AI 분야에서는 에이전트 AI 구축용 기반 모델인 NVIDIA Nemotron에 음성 처리와 안전성에 특화된 새로운 모델도 추가했다.

예를 들어 MultiTalker Parakeet은 여러 명이 동시에 말하는 것처럼 겹치는 음성이나 빠른 대화도 정확하게 알아들을 수 있는 자동 음성 인식 모델. MultiTalker Parakeet을 사용한 NVIDIA MultiTalker ASR 데모 동영상도 공개되어 있다. 여러 명이 동시에 말해도 각자 말하는 내용을 인식하고 실시간으로 문자로 변환한다.

또 Sortformer는 음성 데이터 중에서 누가 언제 말했는지를 구분하는 다이어라이제이션이라는 처리를 실시간 수행한다고 한다. 더구나 AI가 부적절한 발언을 하지 않도록 제어하기 위한 Nemotron Content Safety Reasoning이나 강화학습을 위한 환경 구축을 지원하는 NeMo Gym 등도 오픈소스로 공개됐다. 이들 모델은 라이선스 개방성과 투명성을 평가하는 독립 기관 지표에서 높은 점수를 획득했으며 연구 커뮤니티에 대한 공헌이 인정받고 있다.

엔비디아 젠슨황 CEO는 AI의 다음 큰 물결은 피지컬 AI라고 강조하고 있다. 엔비디아 최고 과학자인 빌 달리 박사도 미래에는 로봇이 사회에서 큰 역할을 할 것으로 보고 있으며 그 두뇌가 될 기술 개발을 진행해 나갈 방침을 밝혔다. 관련 내용은 이곳에서 확인할 수 있다.

![[AI서머리] 워커린스페이스, 90억 규모 프리 A 투자 유치‧인드림헬스케어, 팁스 선정](https://startuprecipe.co.kr/wp-content/uploads/2025/12/251203_kised.or_.kr_504023035-75x75.jpg)