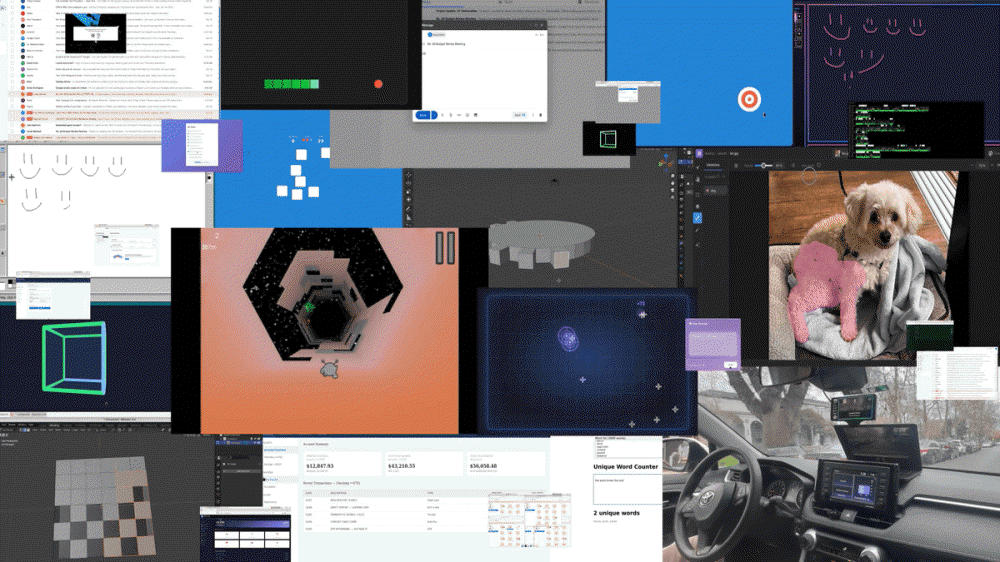

미국 샌프란시스코에 본사를 둔 스탠다드 인텔리전스(Standard Intelligence)가 AI 모델 FDM-1을 발표했다. FDM-1은 1,100만 시간에 달하는 영상을 학습했으며 세계 첫 범용 컴퓨터 액션 모델로 소개되고 있다.

PC를 조작할 수 있는 AI는 이미 상용화되어 있지만 대부분은 PC 스크린샷을 기반으로 개발된 시각 언어 모델(VLM)에 강화학습을 적용하는 방식으로 만들어져 있어 CAD 애플리케이션 조작 등 장시간에 걸친 작업에는 취약하다. 또 시각 언어 모델(VLM)을 개발할 때에는 스크린샷에 적절한 설명을 부여하는 작업이 필요하며 이를 위해 대규모 인력과 많은 시간이 소요된다.

FDM-1은 시각 언어 모델(VLM) 기반 PC 조작 AI와 달리 인터넷상에 존재하는 영상 편집 과정을 기록한 동영상이나 코딩 라이브 방송 등으로 구성된 1,100만 시간 분량 영상을 활용해 학습했다. 또 영상 어노테이션을 자동화하기 위해 IDM이라는 시스템도 개발됐다.

실사 영상 어노테이션을 자동 처리하는 건 어렵지만 PC를 조작하는 영상의 경우 화면에 h가 표시됐다면 h키를 눌렀다는 의미와 같이 화면상 변화와 조작 내용을 1:1로 연결할 수 있어 비교적 용이하게 자동 어노테이션 시스템을 구축할 수 있다. FDM-1 개발 시에는 먼저 4만 시간 분량 영상을 외부 업체에 의뢰해 인력으로 어노테이션하고 해당 데이터를 바탕으로 IDM을 개발한 뒤 1,100만 시간 분량의 영상을 자동 어노테이션했다.

나아가 PC 조작에 특화된 상황에 맞춘 인코더도 개발됐다. 이런 노력을 통해 FDM-1은 3만 6,000프레임 영상을 20만 토큰으로 표현할 수 있는 고효율성을 확보하는 데 성공했다. 동일한 20만 토큰으로 제미나이는 775프레임, 클로드는 162프레임밖에 처리하지 못한다. 개발팀은 2시간 분량 30fps 영상을 100만 토큰으로 압축 가능하다고 밝히며 FDM-1의 높은 효율성을 강조했다.

적은 토큰으로 긴 영상을 처리할 수 있게 됨에 따라 FDM-1은 CG 애플리케이션이나 CAD 애플리케이션 등 장시간의 전후 맥락이 중요한 애플리케이션도 자동으로 실행할 수 있게 됐다. 또 차량 조작을 방향키 입력으로 치환해 FDM-1을 자율주행 시스템으로 전용하는 것도 가능하다.

스탠다드 인텔리전스는 FDM-1을 통해 PC 조작 AI는 학습 데이터에 제약받는 상태에서 연산량에 제약받는 상태로 이행할 수 있다며 성과를 강조했다. 관련 내용은 이곳에서 확인할 수 있다.

![[AI서머리] 어트랙트, 시드 투자 유치‧크릿벤처스, 美 K-컬처 스타트업 2곳에 투자](https://startuprecipe.co.kr/wp-content/uploads/2026/03/260303_acroxar.com_500325-75x75.png)

![[DailyRecipe] 목표는 100개…경기도표 기후테크 34곳 1페이지 브리핑](https://startuprecipe.co.kr/wp-content/uploads/2026/04/260421_Climate-Technology_ai_0503205235-350x250.png)